![]() .

.

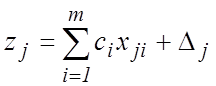

Тогда

,

, ![]() . (2)

. (2)

Относительно погрешностей ![]() сделаем следующие допущения:

сделаем следующие допущения:

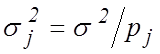

1) погрешности ![]() являются нормально распределенными

случайными величинами с нулевым математическим ожиданием

являются нормально распределенными

случайными величинами с нулевым математическим ожиданием ![]() и дисперсиями

и дисперсиями  , причем

, причем ![]() известны,

а параметр

известны,

а параметр ![]() подлежит оцениванию вместе с

искомыми параметрами

подлежит оцениванию вместе с

искомыми параметрами ![]()

![]() ,

то есть измерения

,

то есть измерения ![]() неравноточные;

неравноточные;

2) погрешности отдельных

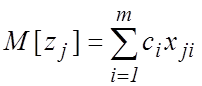

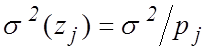

измерений независимы. Из (2) следует, что величины ![]() будут

иметь нормальное распределение с параметрами

будут

иметь нормальное распределение с параметрами

,

,  . (3)

. (3)

Естественно, что при решении

системы (1) вместо величин ![]() придется

использовать наблюдаемые значения

придется

использовать наблюдаемые значения ![]() , причем число

наблюдений, как правило, делают большим числа неизвестных

, причем число

наблюдений, как правило, делают большим числа неизвестных ![]() . В этом случае система (2) не имеет

решения, поэтому оценки неизвестных параметров

. В этом случае система (2) не имеет

решения, поэтому оценки неизвестных параметров ![]() получают

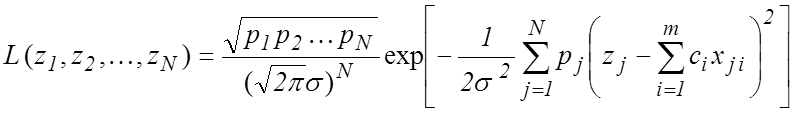

по методу максимального правдоподобия (ММП) или по методу наименьших квадратов

(МНК). С учетом (3) функция правдоподобия выборки

получают

по методу максимального правдоподобия (ММП) или по методу наименьших квадратов

(МНК). С учетом (3) функция правдоподобия выборки ![]() будет

будет

. (4)

. (4)

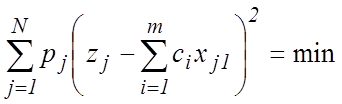

Видно, что при всяком

значении ![]() максимум функции правдоподобия (4)

достигается при выборе

максимум функции правдоподобия (4)

достигается при выборе ![]() таком, что

таком, что

, (5)

, (5)

то есть при выборе ![]() по предписанию

МНК, который является частным случаем ММП, если выборка

по предписанию

МНК, который является частным случаем ММП, если выборка ![]() имеет

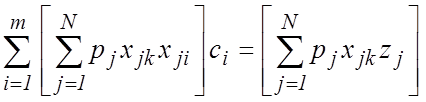

нормальное распределение. Для нахождения минимума (5) найдем

имеет

нормальное распределение. Для нахождения минимума (5) найдем ![]() ее частных производных по

ее частных производных по ![]() и приравняем их нулю. В результате

имеем систему из

и приравняем их нулю. В результате

имеем систему из ![]() нормальных уравнений

относительно

нормальных уравнений

относительно ![]() неизвестных параметров

неизвестных параметров ![]()

![]() , (6)

, (6)

решая которую, получают искомые оценки.

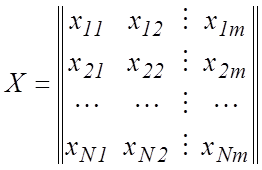

Однако более наглядно система (6) и ее решение могут быть

представлены в матричном виде. Обозначим ![]() ,

,

![]() – соответственно векторы истинных

значений и наблюдаемых значений измеряемых величин;

– соответственно векторы истинных

значений и наблюдаемых значений измеряемых величин;

,

,

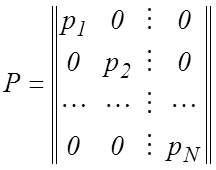

соответственно матрица плана эксперимента, состоящая из известных

величин ![]() , и диагональная матрица весов

измерений;

, и диагональная матрица весов

измерений; ![]() – вектор неизвестных параметров.

– вектор неизвестных параметров.

В данных обозначениях система нормальных уравнений (6) примет вид

![]() , (7)

, (7)

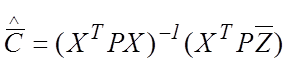

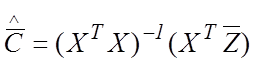

а вектор оценок неизвестных параметров находится из выражения

, (8)

, (8)

где ![]() и

и ![]() –

обозначают соответственно операции транспонирования и нахождения обратной

матрицы. Полученные оценки

–

обозначают соответственно операции транспонирования и нахождения обратной

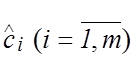

матрицы. Полученные оценки  являются

состоятельными, несмещенными и эффективными [1].

являются

состоятельными, несмещенными и эффективными [1].

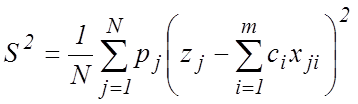

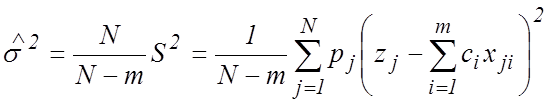

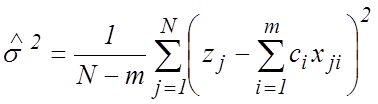

Используя те же экспериментальные данные, можно найти

оценку дисперсии случайной погрешности ![]() .

Для этого продифференцируем логарифм функции правдоподобия (4) по

.

Для этого продифференцируем логарифм функции правдоподобия (4) по ![]() и приравняем производную нулю, тогда

и приравняем производную нулю, тогда

,

,

где в последнее выражение вместо неизвестных параметров ![]() подставлены их оценки максимального

правдоподобия (8). Легко показать, что полученная оценка дисперсии является

смещенной [1], а для нахождения несмещенной оценки необходимо ввести

поправочный множитель

подставлены их оценки максимального

правдоподобия (8). Легко показать, что полученная оценка дисперсии является

смещенной [1], а для нахождения несмещенной оценки необходимо ввести

поправочный множитель

. (9)

. (9)

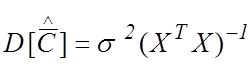

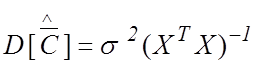

Зная оценку параметра ![]() ,

можно судить о точности оценки коэффициентов

,

можно судить о точности оценки коэффициентов ![]() .

Но погрешности оценивания данных коэффициентов уже не независимы, поэтому они

описываются дисперсионной матрицей ошибок, равной

.

Но погрешности оценивания данных коэффициентов уже не независимы, поэтому они

описываются дисперсионной матрицей ошибок, равной

. (10)

. (10)

Легко видеть, что  является

квадратной, симметричной матрицей

является

квадратной, симметричной матрицей ![]() ; в диагонали ее

стоят дисперсии соответствующих неизвестных параметров

; в диагонали ее

стоят дисперсии соответствующих неизвестных параметров ![]() ,

а в недиагональные элементы определяют ковариации соответствующих им параметров

,

а в недиагональные элементы определяют ковариации соответствующих им параметров

![]() .

.

Основываясь на результатах обработки линейной модели, перейдем к рассмотрению нелинейного случая.

Для решения нелинейной задачи осуществляют искусственную

линеаризацию системы нелинейных уравнений. Пусть задана система нелинейных

уравнений относительно неизвестных параметров ![]() ,

подлежащих оцениванию:

,

подлежащих оцениванию:

![]()

![]() .

.

При этом предполагается, что существует некоторое нулевое

приближение ![]() (начальные оценки) неизвестных

параметров

(начальные оценки) неизвестных

параметров ![]() , причем погрешность его мала, то есть

разности

, причем погрешность его мала, то есть

разности ![]() малы по сравнению с истинными

значениями оцениваемых коэффициентов

малы по сравнению с истинными

значениями оцениваемых коэффициентов ![]()

![]() . Не рассматривая способа

получения начального приближения

. Не рассматривая способа

получения начального приближения ![]() , т.к. в каждом

конкретном случае это является самостоятельной задачей, остановимся на

процедуре уточнения данного приближения. Про погрешности

, т.к. в каждом

конкретном случае это является самостоятельной задачей, остановимся на

процедуре уточнения данного приближения. Про погрешности ![]() сделаем те же самые предположения,

что и в линейном случае.

сделаем те же самые предположения,

что и в линейном случае.

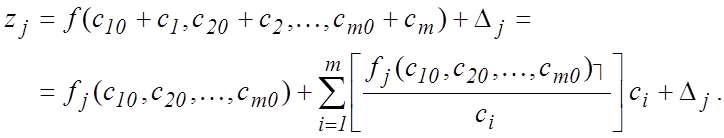

Ввиду малости погрешностей

разложим функции ![]()

![]() в

ряд Тейлора в точке

в

ряд Тейлора в точке ![]() , ограничившись линейными

членами:

, ограничившись линейными

членами:

(11)

(11)

В системе (11) сначала

находятся частные производные ![]() по

по ![]() , а затем вычисляются значения этих

частных производных в точке

, а затем вычисляются значения этих

частных производных в точке ![]() . Получилась

система из

. Получилась

система из ![]() линейных относительно поправок

линейных относительно поправок ![]() уравнений с

уравнений с ![]() неизвестными,

аналогичная системе (2). Решая ее по методике, описанной в предыдущем разделе,

находят неизвестные поправки

неизвестными,

аналогичная системе (2). Решая ее по методике, описанной в предыдущем разделе,

находят неизвестные поправки ![]() и вычисляют

первые приближения оценок

и вычисляют

первые приближения оценок ![]() . Данную

процедуру можно повторить и найти второе приближение оценок

. Данную

процедуру можно повторить и найти второе приближение оценок ![]() , разложив функции

, разложив функции ![]() в ряд Тейлора в точке

в ряд Тейлора в точке ![]() и решив получающуюся систему,

аналогичную (11), относительно поправок

и решив получающуюся систему,

аналогичную (11), относительно поправок ![]() ,

и т.д. То есть в данном случае оценки неизвестных коэффициентов

,

и т.д. То есть в данном случае оценки неизвестных коэффициентов ![]() находятся методом последовательных

приближений. Но для успешной сходимости метода необходимо удачно находить

нулевые приближения

находятся методом последовательных

приближений. Но для успешной сходимости метода необходимо удачно находить

нулевые приближения ![]() , что

зачастую является очень сложной задачей.

, что

зачастую является очень сложной задачей.

Постановка задачи аналогична

разделу 1, где погрешности ![]() измерения величин

измерения величин

![]() предполагаются независимыми,

нормально распределенными с нулевым математическим ожиданием и одинаковой дисперсией

предполагаются независимыми,

нормально распределенными с нулевым математическим ожиданием и одинаковой дисперсией

![]() для всех

для всех ![]() ;

то есть измерения равноточные. В этом случае матрица весов измерений

;

то есть измерения равноточные. В этом случае матрица весов измерений ![]() становится единичной, и выражения

для вектора оценок коэффициентов

становится единичной, и выражения

для вектора оценок коэффициентов ![]() (8), оценки

дисперсии

(8), оценки

дисперсии ![]() (9) и матрицы ошибок

(9) и матрицы ошибок  (10) несколько упрощаются:

(10) несколько упрощаются:

, (12)

, (12)

, (13)

, (13)

. (14)

. (14)

При этом все оптимальные свойства оценок (12) сохраняются.

Очень часто одна физическая

величина ![]() линейно зависит от другой величины

линейно зависит от другой величины ![]() (приведите примеры!)

(приведите примеры!)

![]()

где неизвестные коэффициенты ![]() и

и ![]() находят

из эксперимента. Для этого при фиксированных точно известных значениях

находят

из эксперимента. Для этого при фиксированных точно известных значениях ![]() :

: ![]() измеряют соответствующие значения

измеряют соответствующие значения ![]() , но поскольку в

измерениях присутствуют неизбежные ошибки

, но поскольку в

измерениях присутствуют неизбежные ошибки

![]() ,

то реально результаты измерения получаются

,

то реально результаты измерения получаются

![]() ,

где измеренные величины

,

где измеренные величины ![]() можно представить

в виде

можно представить

в виде

![]() . (15)

. (15)

Уважаемый посетитель!

Чтобы распечатать файл, скачайте его (в формате Word).

Ссылка на скачивание - внизу страницы.