4.1. Метод наименьших квадратов

В дальнейшем мы будем рассматривать задачу аппроксимации только для одномерных переменных x = (x0, x1,…, xn) и y = (y0, y1,…, yn). Геометрически эта задача может быть сформулирована следующим образом: на плоскости OXY задано множество точек (xi, yi), 0 £ i £ n, требуется провести гладкую кривую, которая проходит достаточно близко от этих точек. Такую задачу также называют задачей простой регрессии. Задача простой регрессии заключается в построении функции g(x), связывающей переменные x = (x0, x1,…, xn) и y = (y0, y1,…, yn). При этом x считается независимой переменной, влияющей на значения переменной y. В дальнейшем будем полагать, что нам заданы некоторые экспериментальные данные (xi, yi), 0 £ i £ n, где n+1 – число измерений. Значения yi могут быть заданы точно, а могут содержать погрешность, т.е. yi = f(xi)+ei, где f(x) – некоторая неизвестная функция, а ei – погрешность. В простом регрессионном анализе, как правило, полагается, что e0, e1…en – независимые одинаково распределенные случайные величины.

Отметим, что любая аналитическая зависимость g = g(x), полученная в результате обработки данных, называется эмпирической формулой. Следует также отметить, что в отличии от задачи интерполяции, в этом случае не требуется, чтобы все узлы сетки были различны между собой. То есть данные могут содержать точки, имеющие одинаковые координаты по x (xi = xj при i¹j).

Регрессионная функция (регрессионная модель, модель регрессии, эмпирическая формула) g = g(x) считается функцией, зависящей от параметров c1, c2,…, ck, где k<n+1, например, g(x) = c1+c2x. Таким образом, задача простой регрессии (задача аппроксимации, задача построения эмпирической формулы) разбивается на два этапа:

1) выбор функции (модели) g = g(c1, c2, …, ck, x);

2) нахождение числовых значений параметров c1, c2, …, ck.

Первый этап заметно сложнее второго. Предпочтение отдается простым формулам (полиномы, дробно-рациональные, показательные и другие функции). Нахождение параметров регрессионной функции (параметров регрессии, параметров регрессионной модели, параметров эмпирической формулы) является более легкой задачей, для решения которой используется метод наименьших квадратов (МНК), метод средних, метод выбранных точек и др. На практике чаще всего применяется метод наименьших квадратов, в дальнейшем мы будем использовать только этот метод.

Определение. Величины (yi-g(c1, c2, …, ck, xi)) называются остатками.

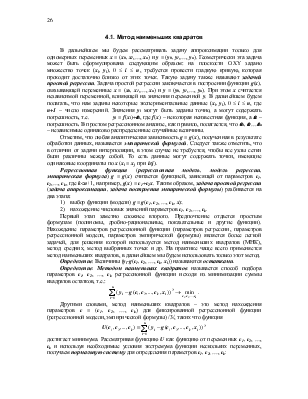

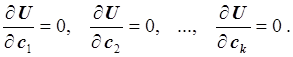

Определение. Методом наименьших квадратов называется способ подбора параметров c1, c2, …, ck регрессионной функции исходя из минимизации суммы квадратов остатков, т.е.:

.

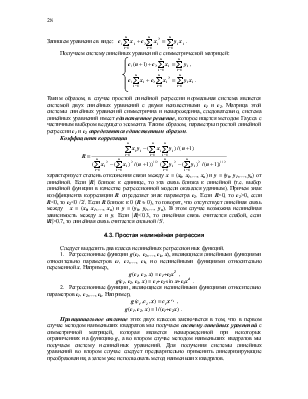

.

Другими словами, метод наименьших квадратов – это метод нахождения параметров c = (c1, c2, …, ck) для фиксированной регрессионной функции (регрессионной модели, эмпирической формулы) /3/, таких что функция

достигает минимума. Рассматривая функцию U как функцию от переменных c1, c2, …, ck и используя необходимые условия экстремума функции нескольких переменных, получаем нормальную систему для определения параметров c1, c2, …, ck:

Если нормальная система имеет

единственное решение, то это решение и будет искомым. Отметим, что если

регрессионная функция g(c1, c2, …,

ck) является линейной функцией относительно c1, c2, …,

ck (например, ![]() ), то

нормальная система является системой линейных уравнений с симметричной

матрицей.

), то

нормальная система является системой линейных уравнений с симметричной

матрицей.

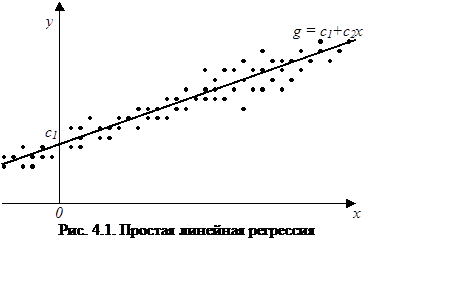

4.2. Простая линейная регрессия

Простая линейная регрессия заключается в

нахождении функции g(c1, c2, x) = c1+c2x, описывающей связь между

собой двух переменных x = (x0, x1,…, xn)

и y = (y1, y2,…, yn).

Таким образом, регрессионная функция уже выбрана, осталось определить параметры

регрессии c1

и c2.

Применим метод наименьших квадратов для их нахождения.

Простая линейная регрессия заключается в

нахождении функции g(c1, c2, x) = c1+c2x, описывающей связь между

собой двух переменных x = (x0, x1,…, xn)

и y = (y1, y2,…, yn).

Таким образом, регрессионная функция уже выбрана, осталось определить параметры

регрессии c1

и c2.

Применим метод наименьших квадратов для их нахождения.

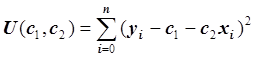

Требуется найти числа c1 и c2, доставляющие минимум функции

Геометрически эту задачу можно сформулировать следующим образом: в облаке точек на плоскости OXY требуется провести прямую, обеспечивая при этом наименьшую среднеквадратичную погрешность (рис. 4.1) /2/.

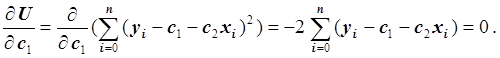

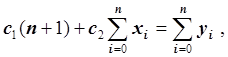

Функцию U(c1, c2) рассмотрим как функцию двух переменных - c1 и c2. Используя необходимые условия экстремума функции нескольких переменных, получаем нормальную систему:

,

,  .

.

Так как функция g = c1+c2x линейна относительно c1 и c2, то получаем систему линейных уравнений для нахождения неизвестных c1 и c2. Запишем первое уравнение:

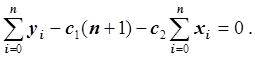

Умножив обе части уравнения на –0.5 и преобразовав, получим:

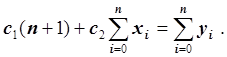

Запишем это уравнение в следующем

виде:

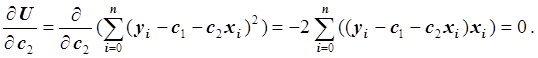

Второе уравнение:

Умножив обе части на –0.5 и

преобразовав, получим:

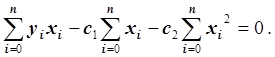

Запишем уравнение в виде:

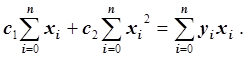

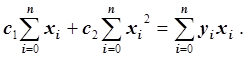

Получаем систему линейных уравнений с симметрической матрицей:

![]()

Таким образом, в случае простой линейной регрессии нормальная система является системой двух линейных уравнений с двумя неизвестными c1 и c2. Матрица этой системы линейных уравнений симметрична и невырожденна, следовательно, система линейных уравнений имеет единственное решение, которое ищется методом Гаусса с частичным выбором ведущего элемента. Таким образом, параметры простой линейной регрессии c1 и c2 определяются единственным образом.

Уважаемый посетитель!

Чтобы распечатать файл, скачайте его (в формате Word).

Ссылка на скачивание - внизу страницы.