Шаговые методы строятся таким образом, чтобы пределом числовой последовательности {z k} было искомое значение экстремума или оптимума zопт .

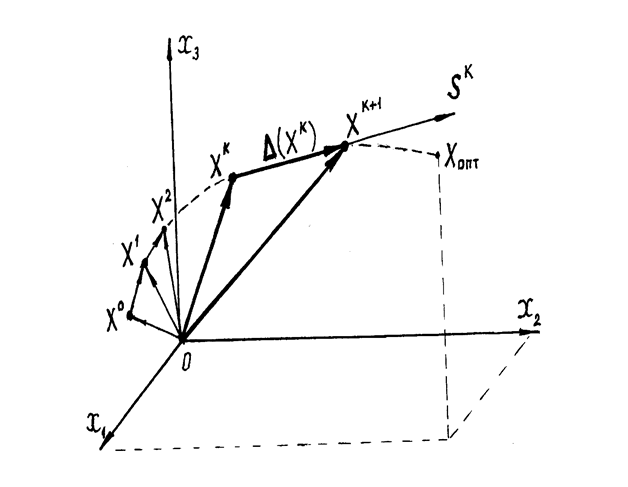

Рассмотрим последовательность точек {Хk }. Будем трактовать построение такой последовательности точек как “движение” точки или как “пошаговое движение” точки в n-мерном пространстве.

Каждый вектор такой последовательности определяется на основании предыдущего вектора той же последовательности следующим образом

Xk+1 = Xk + D(Xk) , k = 0,1,2, … (4.11)

где D(Xk) – n-мерный вектор, называемый шагом.

Таким образом, каждый текущий вектор Xk+1 последовательности представляет собой сумму предшествующего вектора последовательности Xk и вектора - шага D(Xk).

Для случая трехмерного пространства часть векторов такой последовательности может иметь вид, представленный на рис. 4. 6

Шаг D(Xk) , будучи вектором, характеризуется величиной и направлением. Поэтому соотношение (4.8) обычно записывается в более детализированной форме. В ней шаг представляется в виде произведения вектора направления Sk на некоторое число hk, называемое длиной (величиной) шага:

Xk+1 = Xk+ hkSk , k = 0,1,2, … (4.12 )

Вектор направления изображен на рис. 4.6 (при 0< hk < 1).

З а м е ч а н и е 4.9. Число hk часто называют шагом в направлении Sk или просто шагом. Очевидно, что такая величина является скалярной. Будем все же считать такое сокращение допустимым, но полагать, что термин “шаг” обозначает прежде всего вектор D(Xk). Будем использовать также понятие “модуль шага”, понимая под этим модуль вектора D(Xk).

Таким образом, в шаговых методах вычисление очередной точки Xk+1 разбивается на два этапа:

1) выбор направления Sk спуска из точки Xk в сторону уменьшения z(X);

2) определение величины шага спуска hk.

В соответствии с формулами (4.11) и (4.12) для определения текущей точки Xk+1 достаточно знание лишь предыдущей точки Xk . Вместе с тем существует ряд шаговых методов, в которых шаг D(Xk) рассчитывается учетом нескольких предшествующих точек последовательности. Формально такой шаг представляется в виде D(Xk, Xk-1, …, Xk-r ), где r- число точек, предшествующих последней.

Естественно, что алгоритмы поиска с шагом, вычисляемым таким образом, могут обеспечить более высокую скорость сходимости к экстремуму, поскольку используют дополнительную информацию об особенностях оптимизируемой функции.

Следует подчеркнуть, что шаговые методы, реализующие соотношения (4.10), (4.11) и (4.12) обеспечивают нахождение лишь локального экстремума.

4.2.3.3. Общие проблемы шаговых методов

Как будет показано ниже, шаговые методы отличаются большим разнообразием. При их использовании возникает необходимость в решении одних и тех же вопросов, которые мы будем условно называть проблемами.

1) Проблема начальной точки.

В каждом из рассматриваемых методов итерационный процесс должен начинаться с выбора некоторой точки начального приближения или начальной точки поиска, обычно обозначаемой символом X0.

Уважаемый посетитель!

Чтобы распечатать файл, скачайте его (в формате Word).

Ссылка на скачивание - внизу страницы.