Историческую основу информатики составляли такие науки как техническая кибернетика, теория автоматического управления и вычислительная техника.

Понятие информации и ее виды.

Информация – понятие, в переводе с латинского означает осведомление, разъяснение. Информацию разделяют на априорную (доопытную) и апостериорную (послеопытную).

Информация не зависит от объектов.

Прагматическ. – возможность достижения данной цели с использованием получаемой информации.

Семантич. – позволяет оценить смысл передаваемой информации соотнося ее с информацией до появления данной. Семантические связи между словами, смысловыми элементами языка отражают тезаурус. Он состоит из 2 – х частей:

1. список слов и устойчивых словосочетаний.

2. алфавитный словарь, позволяющий расположить в определенном порядке слова, степень изменения которых может служить как характеристика количества информации.

Синтаксический – (правило передачи) – способ представления информации.

Сообщение – характерный носитель информации – это электрический сигнал.

Виды информации:

1. массовая

2. специальная

3. документ.

Информационный ресурс – это конкретизация имеющихся фактов, данных и знаний по направлению науки и техники.

Понятие сообщения и кода.

![]() Сигналы статические динамические

Сигналы статические динамические

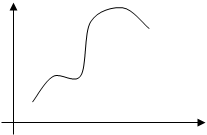

1. непрерывная функция непрерывного аргумента.

f

f

t

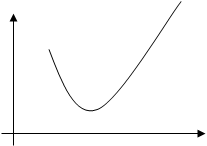

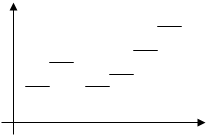

2. непрерывная функция дискретного аргумента (квантование по времени).

|

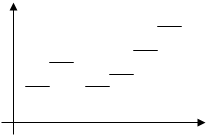

3. дискретная функция непрерывного аргумента (квантование по уровням – ступенчатая)

|

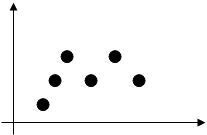

4. дискретная функция дискретного аргумента.

|

В целях систематизации сообщения и обеспечить возможности его передачи по каналам связи используется кодирование.

Код – это такое представление сообщения, в котором это сообщение пригодно для передачи. Основное требование кода: возможность различия их на приемной стороне по каналам связи. Коды подразделяются:

1. по основанию системы счисления делятся на двоичные (01), троичные (012) и четверичные (0123).

2. по построению коды делятся на систематические (1010) и несистематические (11001010001100).

3. по наличию избыточности – на избыточные и неизбыточные.

4. по корректирующим свойствам: обнаруживающие, исправляющие, корректирующие.

5. по расположению элементов кода: последовательные, параллельные, послед. – параллельные.

Количественные характеристики информации:

Известны 3 способа измерения количества информации:

1. объемный;

2. энтропийный;

3. аморитмический.

Энтропия – общая мера неопределенности, которая характеризуется некоторой математической зависимостью от совокупности вероятностей некоторых событий, несущих информацию.

H=log232=5

hi=log(1/Pi)=-log2Pi – формула собственного количества информации.

Алгоритм – это процедура, которая позволяет путем выполнения последовательности элементарных шагов получить однозначный результат или за конечное число шагов прийти к выводу о том, что решения не существует.

Алгоритм – это конечный набор правил, позволяющий чисто механически решать любую конкретную задачу из некоторого класса однотипных задач.

Свойства:

1. детерминированность – (правила едины для всех) метод действия настолько точен и общепонятен, что не оставляет место произволу.

2. массовость

3. результативность (направленность) получения решения или нет.

Область применимости алгоритма – это наибольшая область начальных данных, на которой алгоритм результативен.

3 класса арифметической модели.

1. Ариф – ция алгоритмов предполагает, что все действия

2. каждый шаг алгоритма считается элементарным и выполнимым, так чтобы его могла выполнить машина, обладающая простотой и универсальностью.

Машина Тьюрина состоит из 3-х частей: управляющее устройство, магнитная головка и лента.

A={a1, a2, … am} – арифметическая машина,

Q={q1, q2, … qn} – множество состояний машины,

qi

xy

qi

xy

aj << >> ar am << >>

d – перемещение головки, a – слово на ленте.

3. нормальные алгоритмы Маркова. Для нормальных алгоритмов задается алфавит, над которым он работает, конечное множество допустимых подстановок и порядок их применения.

Структура и фазы преобразования информации в ИС.

Фазы подготовки информации:

1. регистрация информации;

2. сбор и передача информации;

3. обработка информации (хранение);

4. вывод информации (воспроизведение);

5. классификация;

6. синтез.

Свойства информации:

Способ передачи информации

Цель информации

Избыточность информации

Верность информации (степень доверия информации)

Периодичность появления информации.

Квантование сигналов от уровня.

Определяется шагом квантования. Если А

достигнет текущего сигнала одного из уровней квантования

Определяется шагом квантования. Если А

достигнет текущего сигнала одного из уровней квантования

Уважаемый посетитель!

Чтобы распечатать файл, скачайте его (в формате Word).

Ссылка на скачивание - внизу страницы.